訪問介護事業所向けに、利用者・ご家族からのLINE問い合わせをAIで自動応答するシステムを開発しています。先日、テキストだけでなく音声メッセージにも対応する機能を追加しました。

技術的な実装手順は別記事で公開していますが、本記事は事業者向けに「そもそもAIに何を任せていいのか、何を任せてはいけないのか」を整理します。介護現場で生成AIを使う以上、避けて通れない論点です。

技術的にすごい仕組みを作っても、ここの設計を誤ると事業者にとって致命的なリスクになります。実装を進める中で当社が考えたこと・調べたことを、事業者の方が判断材料として使えるように整理した記録です。

LINEを使ったAIチャット・音声チャットとは

最初に、本記事で扱う「LINEを使ったAIチャット・音声チャット」がどういうものか説明します。

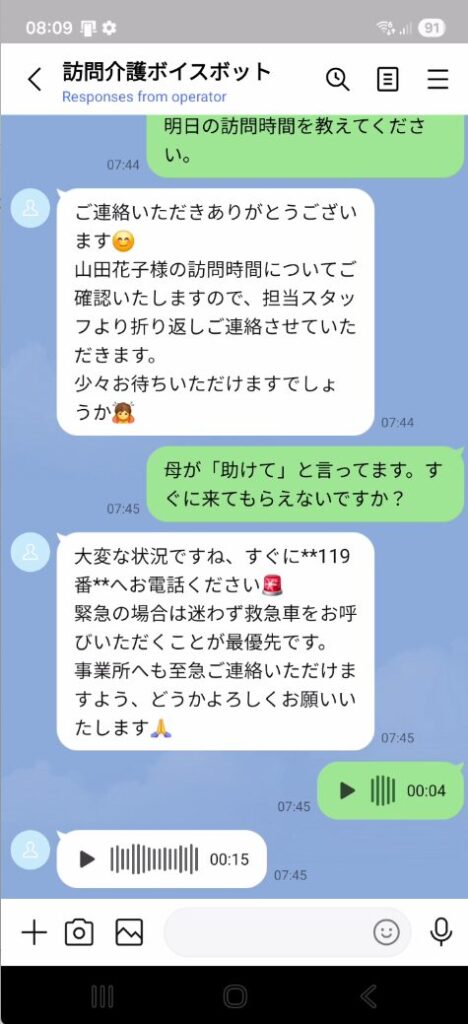

仕組みとしては、事業所が運営するLINE公式アカウントに、利用者やご家族が普段通りメッセージを送ると、その問い合わせ内容に応じてAIが自動的に返信する、というものです。

たとえば「明日の訪問時間を教えてください」とLINEで送ると、AIが事業所の情報をもとに自動で「明日は午前10時にお伺いする予定です」のような形で返信します。テキストだけでなく、LINEの音声メッセージ機能で話しかけても、AIが内容を理解して音声で返答します。

ご家族世代はLINEのテキストで問い合わせる方が多い一方で、高齢のご家族や音声入力に慣れた方からは「文字を打つのが大変なので音声で送りたい」というご要望があります。テキスト・音声の両方に対応することで、利用者層の幅広いニーズに応えることができます。

事業者にとってのメリットは明確です。営業時間外でも問い合わせに自動応答できるため、24時間体制で利用者・ご家族からの連絡に対応する仕組みが、人を雇わずに作れます。事務担当者が電話対応に時間を取られている事業所では、定型的な問い合わせをAIに任せることで、現場業務に集中できる時間が増えます。

「ボイスボット」とは何か

関連用語として「ボイスボット」という言葉も最近よく聞きます。これはAIによる自動音声対応の総称で、世の中には大きく2つのタイプがあります。

① 電話に応答するボイスボット

事業所の電話番号にかかってきた電話に、AIが応答するタイプです。利用者が普通に電話をかけると、AIが「お電話ありがとうございます、AIアシスタントが対応します」のように応答します。利用者は電話を使い慣れた高齢者でも問題なく利用できる反面、構築には専用の電話インフラ(Twilioなど)と高度な技術が必要です。

② LINEなどメッセージアプリ経由のボイスボット

LINEやWhatsAppなどのメッセージアプリで、テキストや音声メッセージのやり取りをAIが行うタイプです。本記事で扱っているのはこちらのタイプです。電話と違って双方向の同時通話ではなく、「利用者が音声を録音して送る → AIが返答を音声で送る」という形のやり取りになります。

事業者として導入を検討する際、どちらのタイプが適しているかは利用者層によります。ご家族中心の問い合わせならLINEタイプが現実的で、高齢者本人が直接連絡する場合は電話タイプの方が向いています。両方を組み合わせて運用する事業所も増えてきています。

本記事では、②のメッセージアプリ経由のボイスボットを前提に話を進めます。

なぜAIに任せられない領域があるのか

訪問介護事業所のLINE問い合わせには、さまざまな内容が来ます。

定型的な問い合わせの代表例は、「明日の訪問時間を教えてください」「持ち物は何が必要ですか」「駐車場はどこですか」などです。これらはAIで十分対応できます。むしろ、24時間365日、待たせずに応答できる点でAIの方が優れています。

しかし、中にはAIが答えてはいけない領域があります。

医療判断を伴う相談

「薬を飲み忘れたんですが、まとめて飲んでも大丈夫ですか」

「最近食欲がないんですが、何を食べさせたらいいですか」

「熱が38度あります。様子を見ていいですか」

これらにAIが具体的なアドバイスを返したらどうなるか。たとえば「2回分まとめて飲んでも大丈夫ですよ」と返した結果、利用者の体調が悪化したら、事業者の責任は免れません。医療の分野でのAI導入は今後進んでいくと考えられますが、現時点では医師による診断は不可欠です。

精神的な不調を訴える発言

「もう疲れました」

「生きていても仕方ない気がします」

「あの世に行ってしまった主人のところに早く行きたい」

これらにAIが「励ましの言葉」を返してしまったらどうなるでしょうか?。仮にAIが「大丈夫ですよ、頑張りましょう」と返した結果、その方が自傷行為に至った場合、事業者として何の対応もしていなかったことになります。

緊急事態の通報

「父が倒れました、息をしていません」

「血が止まりません」

「火事になっているかもしれません」

1分の遅れが命に関わる場面では、AIに任せた結果初動が遅れる事はなんとしても避けなければなりません。

法的責任を負うリスク

これらの場面でAIが誤った応答をした場合、事業者には法的責任を負うリスクが降りかかります。

訪問介護事業者には、介護保険法上の運営基準で利用者の心身の状況把握と適切な対応が義務付けられています。AIが不適切な応答をして利用者に損害が生じた場合、「事業者の管理責任」が問われる可能性があります。

医療判断に関する不適切な助言は、医師法・薬剤師法の観点でも問題になり得ます。AIが応答したからといって、事業者の責任が免責されるわけではありません。むしろ「AIを業務に組み込んだのは事業者の判断」として、責任が増す方向に働くケースもあります。

なお、当社は法律や医療の専門家ではありません。本記事で触れる法令の解釈や具体的な責任範囲については、所轄の行政書士・弁護士・医療法務に詳しい専門家にご確認ください。本記事は「事業者として法的観点を意識する必要がある」という気付きの提供を目的としており、個別ケースの法的判断を保証するものではありません。

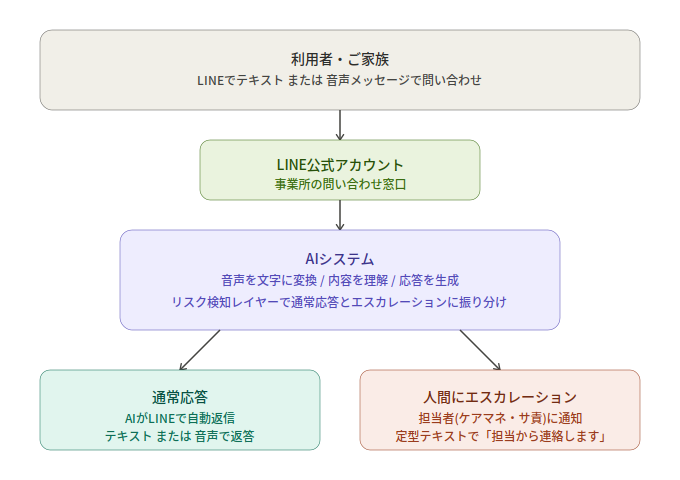

「リスク検知レイヤー」という考え方

これらのリスクに対応するため、AI応答システムには「リスク検知レイヤー」を組み込むべきだと当社は考えています。

仕組みを簡単に説明すると、以下のようになります。

LINEで受信したメッセージ

↓

リスク検知レイヤーで分類

↓

├─ 通常の問い合わせ → AIが応答

└─ リスクのある内容 → AI応答を停止 → 担当者に通知リスクのある発言を検知したら、AIは自由応答せず、固定テンプレートで「担当者にすぐ連絡します」とだけ返す。同時にケアマネジャーやサービス責任者にLINEなどの通知が飛び、人間が引き継ぐという設計です。

これは「AIで全部捌こうとしない」という思想の表れです。AIに任せきった結果、最も重要な場面で適切な対応ができないシステムになっては本末転倒です。

実装してみて改めて分かったのは、リスク検知の仕組みを作ること自体は技術的にそれほど難しくないということです。難しいのは、「何をリスクとみなすか」の業種別の整理と、「誰にどう繋ぐか」の運用設計です。技術より、業務理解と運用設計の方が遥かに重要です。

どんな発言を「リスクあり」と判定すべきか

訪問介護の文脈で、リスク検知の対象となる発言を4つのカテゴリに整理しました。

| カテゴリ | 概要 | 検知ワード例 | AI側の応答 |

|---|---|---|---|

| 緊急対応 | 生命・身体に直接関わる発言。即座に救急対応の案内が必要 | 「倒れた」「息してない」「意識がない」「救急車」「心臓が」「呼吸が」「痙攣」「出血」 | 「119にお電話ください、同時に担当者に連絡しています」 |

| 自傷リスク | 精神的な不調が深刻化しているサイン | 利用者を動揺させる可能性があるため記述を控えます。実装時は介護現場の経験者やメンタルヘルス専門家と相談しながらリスト作成を推奨 | 「担当のケアマネジャーがすぐにご連絡します」+ よりそいホットライン(0120-279-338)、いのちの電話(0570-783-556)の案内 |

| 強い精神的苦痛 | 直接的なリスクワードを含まないが、抑うつ的な発言 | 「もう無理」「生きてる意味」「いなくなりたい」「つらい」「助けて」 | 担当者から折り返し連絡する旨を返答 |

| 医療判断 | 薬の量、症状の判断などAIに任せると誤情報を提供しかねない領域 | 「薬を」「症状」「熱がある」「痛い」「血が」「腫れている」 | 「担当のケアマネジャーに確認してご連絡しますね」で固定 |

このうち「強い精神的苦痛」のカテゴリは検知が難しく、キーワードだけでは取りこぼしがちです。「もう何もかもどうでもいい」「夜になると涙が止まらなくて」のような、明確なリスクワードを含まない発言も該当します。次の章で説明する通り、キーワードに加えて軽量AIによる文脈判定を組み合わせることで、こうした取りこぼしを減らせます。

キーワードだけでは検知できない

一見シンプルに見えるリスク検知ですが、実装してみるとキーワードマッチだけでは取りこぼしが多いことに気づきました。

たとえば以下の発言を、キーワード辞書だけで判定できるでしょうか。

「もう何もかもどうでもいい気分です」

「最近、何を見ても虚しいんです」

「夜になると涙が止まらなくなって」

これらは明確なリスクワードを含まないものの、精神的な危機のサインである可能性が高い発言です。経験豊富な介護スタッフなら即座に「これは話を聞かなければ」と判断するでしょう。

そこで当社では、二段階の検知ロジックを導入しました。

二段構えにすることで、コストを抑えつつ取りこぼしを減らせます。キーワードでは検知できなかった発言も、文脈を理解するAIなら「精神的苦痛」として判定できます。

事業者として導入を検討する際、「リスク検知の仕組みは入っているか」「キーワードだけでなくAIによる文脈判定もあるか」は、必ず業者に確認すべきポイントです。

エスカレーション先の設計

リスクを検知したら、誰に・どのような形で通知するか。これも事業者として設計が必要です。

時間帯別のエスカレーション先

訪問介護事業所は24時間体制ではないことが多いため、時間帯別に通知先を切り替える設計が現実的です。

日中(営業時間内):

サービス提供責任者またはケアマネジャーに即時通知が飛びます。SlackやLINE WORKSなどのビジネスチャットツールが現実的です。緊急性が高ければ管理者の携帯電話にSMS。1時間以内に折り返し連絡する運用を組み込みます。

夜間・休日:

当直担当者がいれば、その担当者に通知。いなければ翌朝サ責が確認する運用です。AI側からは「24時間対応の専門窓口」を案内するテンプレートを返します。

通知時のテンプレート例

LINE側で利用者に返す定型文も、カテゴリ別に用意します。

緊急対応の場合:

お話くださってありがとうございます。 担当者にすぐ連絡しています。 緊急の場合は救急車(119)をお呼びください。

自傷リスクの場合:

お話くださってありがとうございます。 担当のケアマネジャーがすぐにご連絡します。 今すぐ話を聞いてほしいときは、 よりそいホットライン(0120-279-338)が24時間つながります。 いのちの電話(0570-783-556)もご利用いただけます。

これらのテンプレートは、専門窓口の電話番号を必ず明記することを意識しています。AIが完璧な対応をしようとせず、専門家にバトンを渡す設計です。

「うちの事業所はどんな表現を使うべきか」「どの専門窓口を案内すべきか」は、事業者と業者で擦り合わせて決める内容です。テンプレートが事業者の運用と合っていないシステムは、現場で機能しません。

個人情報の取り扱い

リスク検知の話と並行して、もう1つ重要な設計が個人情報の保護です。

利用者の氏名・住所・電話番号などの情報は、AIに渡る前にマスキング処理を行います。具体的には、メッセージに含まれる電話番号、郵便番号、登録済み利用者名を、識別子([PHONE]、[ZIP]、[USER_0])に置き換えます。

変更前:

田中花子さんの薬を取りに行きます。電話番号は090-1234-5678です。

変更後:

[USER_0]の薬を取りに行きます。電話番号は[PHONE]です。

なぜマスキングが必要かというと、OpenAIやAnthropicなどの大手AI事業者は、自動モデレーションシステムが疑わしいと判定した会話内容を、人間のレビュアーが確認することがあると利用規約に明記しています。

学習に使われることはありませんが、安全性レビュー目的で人間の目に触れる可能性は残ります。

介護現場の機微情報(利用者の氏名、住所、健康状態、家族構成など)が外部のレビュアーの目に触れる可能性を、設計レベルで最小化することが、信頼される事業運営につながります。

業者選定時には「APIに渡す前に個人情報をマスキングする処理が組み込まれているか」を必ず確認してください。「OpenAIは学習に使わないので大丈夫です」と説明する業者もいますが、それは学習の話であって、レビュー閲覧の話ではありません。

段階的なロールアウトの推奨

リスク検知付きAI応答システムを導入する際、いきなり全利用者に開放するのではなく、段階的にロールアウトすることを推奨します。

事業所スタッフ(管理者・サービス責任者)2〜3名でフル機能テスト。実環境でリスク検知の誤検知・見逃しを確認します。

協力的な利用者ご家族3〜5名に限定開放。毎日リスク検知ログと会話履歴をレビューし、誤応答や検知漏れがあれば、システムプロンプトとリスクキーワード辞書を調整します。

全利用者・ご家族に告知して開放。月1回の会話ログレビューを定期化し、運用品質を維持します。

この段階的アプローチが重要なのは、AIシステムは運用しながらチューニングするものだからです。最初から完璧なシステムは作れません。誤検知を1件、見逃しを1件、丁寧に拾って改善していく作業を、最低でも3ヶ月は続ける覚悟が必要です。

システムの設計業者を選ぶ際は、「導入後3ヶ月の運用支援」がサービスに含まれているかを確認してください。「作って終わり」の業者は、この最初の3ヶ月で確実に問題を放置します。

「リスク検知付きAI応答」は介護以外でも必要

ここまで訪問介護の文脈で記事を書いてきましたが、この設計思想は他の業種でも応用可能です。

- クリニック・歯科

-

「胸が痛い」「呼吸が苦しい」などの緊急症状をAIが応答してしまわない設計

- 法律事務所・士業

-

「明日が裁判」「逮捕されました」などの法的期限を伴う相談を取りこぼさない設計

- 不動産管理

-

「ガス漏れ」「水漏れ」「鍵閉め出し」などの緊急修繕を24時間対応する設計

- 建設業・工務店

-

「現場で事故が」「労災」などの初動対応を確実に人に繋ぐ設計

- 飲食店

-

「アレルギー反応が出た」「異物が入っていた」などの食品安全リスクをAIが軽率に対応しない設計

業種ごとに「人命・身体に関わる発言」「法的期限のある相談」「金銭被害の通報」「未成年関連」のいずれかが含まれます。AIで一次対応する以上、これらをエスカレーションする仕組みを必ず組み込むべきだと考えています。

月額コストの目安

技術的な詳細は別記事に譲りますが、コスト感だけ共有しておきます。

訪問介護事業所1拠点・利用者30名・月500メッセージ程度の利用で、各サービスの月額コストは合計で32ドル(約4,800円)でした。AIモデルの利用料、音声合成サービス、サーバー運用費などの合計です。

商用のAI電話・ボイスボットサービスが月額数万円〜数十万円する中で、自前で構築・運用する場合のコストはこの範囲に収まります。中小事業者でも導入の現実性が高いことが分かります。

ただし、これは「サービス自体の運用費」であって、初期構築費・運用支援費は別です。業者にカスタム開発を依頼する場合、初期構築で数十万〜数百万円、運用支援で月額数万円程度が相場です。それでも、AI電話の市販SaaSと比べれば、業種特化の柔軟性とリスク検知レイヤーの実装を含めて経済合理性が高い選択肢になります。

まとめ

AI電話や音声AIアシスタントは、中小事業者の人手不足を解決する有力な選択肢です。しかし、業種特有のリスクを考慮しないまま導入すると、かえって大きなリスクを抱えることになります。

特に介護・医療・士業など、人命や法的責任が絡む業種では、「AIで応答していい範囲」と「AIに任せてはいけない範囲」を明確に設計することが、システムの品質を決定づけます。

リスク検知レイヤー、二段階の判定ロジック、時間帯別のエスカレーション、合成音声を使わない判断、個人情報のマスキング、段階的ロールアウト。これらは技術的には地味ですが、業務AIを「使えるもの」にするかどうかの分かれ目です。

「うちの業種でもAI電話・音声AIを使えるか」「既存システムとの連携はどう設計すべきか」「業者選定で失敗したくない」など、判断に迷う場面では、専門家に相談することをお勧めします。

技術詳細を知りたい方は、以下の記事で実装手順を公開しています。エンジニアの方や、自社で内製したいとお考えの方は、こちらをご参照ください。

コメント